Es gibt eine Annahme, die in fast jedem KI-Projekt steckt, ohne je ausgesprochen zu werden: Die KI funktioniert schon irgendwie richtig.

Diese Annahme ist verständlich. KI-Systeme liefern Antworten, die klingen, als kämen sie von einem Experten. Sie arbeiten schnell, konsistent und ohne Beschwerden. Wer soll da zweifeln?

Das Problem ist nicht, was die KI sagt. Das Problem ist, was niemand überprüft hat: Ob die Ausgaben korrekt sind. Ob der Prozess nachvollziehbar ist. Ob das System den Anforderungen standhält, die heute gelten – und morgen noch gelten werden.

Seit August 2024 ist der EU AI Act geltendes europäisches Recht. Er unterscheidet zwischen Anbietern und Betreibern von KI-Systemen – und macht Betreiber, also Unternehmen, die KI einsetzen, direkt haftbar. Wer heute kein Bild davon hat, welche seiner KI-Systeme als hochriskant eingestuft werden könnten, hat ein offenes Compliance-Risiko. Kein Entwurf, keine Ankündigung – geltendes Recht.

Ein KI-Audit ist die Antwort auf diese Lücke.

Was ein KI-Audit wirklich prüft

Der Begriff „Audit“ klingt nach Buchhaltung. In der Realität ist ein KI-Audit eine strukturierte Untersuchung entlang von drei Dimensionen, die zusammen ein vollständiges Bild des KI-Einsatzes im Unternehmen ergeben.

Output-Audit: Was gibt das System tatsächlich aus?

Die erste Frage ist die einfachste – und die, die am seltensten gestellt wird. Stimmen die Antworten des Systems? Gibt es systematische Muster in den Fehlern? Weicht die KI in bestimmten Kontexten von dem ab, was ein menschlicher Experte sagen würde?

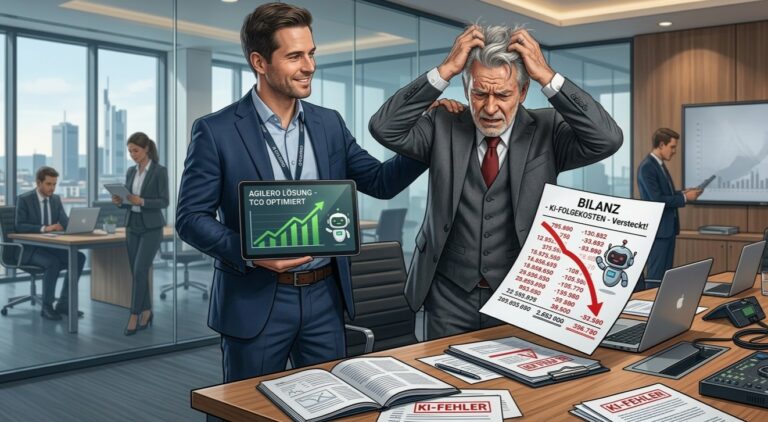

Ein Output-Audit macht Fehler sichtbar, bevor sie Konsequenzen haben. Was ein KI-Fehler tatsächlich kostet – an Nacharbeit, Reputationsschaden und Haftungsrisiko – ist in den meisten Unternehmen nicht bilanziert. Der Audit liefert die Grundlage dafür.

Prozess-Audit: Ist das System nachvollziehbar?

Die zweite Dimension betrifft nicht das Ergebnis, sondern den Weg dorthin. Welche Daten fließen in welchem Moment in das System ein? Welche Entscheidungen trifft die KI autonom, welche werden von Menschen überwacht oder freigegeben?

Diese Frage ist keine akademische. Regulierer, Wirtschaftsprüfer und in Zukunft auch Kunden werden Nachweise verlangen. Wer nicht dokumentieren kann, wie sein KI-System zu einem Ergebnis kommt, steht ohne Antwort da.

Datenschutz- und Cloud-Act-Audit: Wo liegen Ihre Daten wirklich?

Die dritte Dimension ist die, die die wenigsten auf dem Schirm haben. Viele KI-Systeme laufen auf US-amerikanischen Cloud-Infrastrukturen. Der US CLOUD Act erlaubt amerikanischen Behörden unter bestimmten Umständen den Zugriff auf diese Daten – unabhängig davon, ob die Server physisch in Europa stehen. Für Unternehmen mit vertraulichen Kundendaten, Verträgen oder internen Prozessen ist das kein theoretisches Risiko.

Die Frage, die kein Projektleiter stellt

In fast jedem KI-Projekt gibt es einen Moment, in dem die Frage hätte gestellt werden müssen: Wer überprüft eigentlich, was das System tut?

Dieser Moment wird übersprungen. Nicht aus Nachlässigkeit, sondern weil die Antwort unbequem ist. Sie würde bedeuten, Ressourcen für etwas einzuplanen, das keinen sichtbaren Output erzeugt. Kein Feature, kein Dashboard, kein Release.

Was dabei übersehen wird: Die Entscheidung, wann ein Mensch eingreift und wann die KI autonom handeln darf, ist keine technische Frage – sie ist eine strategische. Human-in-the-Loop bedeutet nicht, dass ein Mensch jede Ausgabe kontrolliert. Es bedeutet, dass jemand im Unternehmen bewusst entschieden hat, welche Entscheidungen die KI alleine treffen darf – und welche nicht. Diese Entscheidung ist dokumentiert, begründet und revidierbar.

In den meisten Unternehmen ist sie nicht getroffen worden. Der KI-Audit deckt auf, wo diese Lücken liegen.

Was passiert, wenn kein Audit stattfindet?

Das System läuft weiter. Die meisten Fehler bleiben unsichtbar – bis sie es nicht mehr tun. Bis ein Kunde eine fehlerhafte KI-Empfehlung als Grundlage einer Entscheidung verwendet. Bis ein Regulierer nachfragt, welche Hochrisiko-Systeme im Einsatz sind. Bis ein Konkurrent mit einer auditierten, nachweisbar verlässlichen KI-Lösung antritt und das Vertrauen gewinnt, das Sie sich nicht aufgebaut haben.

Ein Audit ist kein Bürokratieakt. Er ist die Versicherung, dass Sie wissen, was in Ihrem Unternehmen läuft.

Wer sollte einen KI-Audit durchführen?

Die naheliegende Antwort ist: die eigene IT-Abteilung. Die ehrliche Antwort ist: das funktioniert nicht.

Nicht weil IT-Teams inkompetent wären. Sondern weil Audits Unabhängigkeit voraussetzen. Wer ein System eingeführt hat, hat ein natürliches Interesse daran, dass es gut dasteht. Das ist kein Vorwurf – es ist menschlich. Und es macht interne Audits strukturell ungeeignet für eine unabhängige Bewertung.

Wer die KI prüft – und mit welchem Mandat – ist eine Frage, die viele Unternehmen noch nicht beantwortet haben. Ein externer Auditor bringt methodische Distanz, ein strukturiertes Prüfrahmenwerk und – entscheidend – ein Ergebnis, das nach innen und außen Bestand hat.

Das Audit-Ergebnis ist kein internes Memo. Es ist ein Dokument, das gegenüber Geschäftspartnern, Kunden und Regulierern verwendet werden kann. Der Unterschied zwischen einem internen Bericht und einem externen Audit ist der Unterschied zwischen einer Selbstauskunft und einem Zertifikat.

Der AGILERO KI-Audit

Wir haben drei Pakete entwickelt, die unterschiedlichen Prüftiefen und Unternehmensgrößen entsprechen.

Paket A — KI-Governance Stresstest: Eintägiges Remote-Audit für 2.900 € Festpreis. Geeignet für Unternehmen, die einen ersten strukturierten Überblick benötigen, bevor sie in eine umfangreichere Prüfung investieren.

Paket B — KI-Audit mit Auditierbarkeits-Roadmap: Vollständige Prüfung entlang aller drei Audit-Dimensionen über 3–4 Wochen für 7.900 € Festpreis. Ergebnis: ein Auditierbarkeits-Bericht und eine konkrete Roadmap, welche Systeme in welcher Reihenfolge nachgerüstet werden sollten.

Paket C — KI-Audit + Betriebsmodell: Der Audit wird auf den Aufbau eines vollständigen KI-Betriebsmodells ausgeweitet. Paket B wird vollständig angerechnet. Gesamtinvestition: 32.000–42.000 €.

Was alle drei Pakete gemeinsam haben: Sie liefern keine abstrakten Empfehlungen, sondern eine konkrete Auditierbarkeits-Architektur-Skizze – eine Darstellung, welche technischen und organisatorischen Maßnahmen notwendig sind, damit Ihr KI-System nachweisbar prüfbar ist.

Das ist der Unterschied zu einem klassischen Beratungsbericht.

Sprechen Sie uns an, bevor Ihre nächste KI-Investition getroffen wird – nicht danach.